Генеративный ИИ присваивает авторство наших работ. Это серьезная проблема

AI-детекторы ошибаются в 61% случаев для неносителей языка, Model Collapse деградирует модели, а эффект Данинга-Крюгера усиливается. Аналитический обзор на основе исследований 2024–2026.

1. Введение

В феврале 2026 года исследователь Харрис Георгиу (PhD) провел показательный эксперимент: загрузил свой собственный, ранее нигде не опубликованный текст в шесть популярных инструментов обнаружения ИИ-контента. Результаты оказались поразительно противоречивыми — от «100% написано человеком» до «86% сгенерировано ИИ». Один и тот же текст, один и тот же автор — шесть разных вердиктов.

Этот эксперимент обнажил целый клубок взаимосвязанных проблем, которые стремительно нарастают в эпоху генеративного ИИ: ненадежность инструментов детектирования, скрейпинг авторского контента без согласия, деградация моделей при обучении на синтетических данных и когнитивные искажения пользователей. Настоящий обзор анализирует каждую из этих проблем, опираясь на актуальные исследования 2024–2026 годов.

2. AI-детекторы: шесть инструментов — шесть противоречий

Эксперимент Георгиу не является единичным случаем. Систематические исследования подтверждают, что AI-детекторы текста остаются фундаментально ненадежными.

2.1. Масштаб проблемы ложных срабатываний

Компания OpenAI, создатель ChatGPT, запустила в 2023 году собственный AI-детектор, но была вынуждена закрыть его уже через полгода. Инструмент верно идентифицировал лишь 26% текстов, написанных ИИ, при этом ошибочно помечая 9% человеческих текстов как сгенерированные. Это провал по обоим направлениям — и по чувствительности, и по специфичности.

Даже лучшие коммерческие инструменты, такие как Turnitin, заявляющие о частоте ложных срабатываний в 1–2%, при масштабном применении создают серьезные проблемы. Университет Вандербильта, обрабатывающий порядка 75 000 студенческих работ в год, подсчитал, что при таком уровне ошибок около 750 студентов ежегодно были бы ложно обвинены в использовании ИИ. Руководство университета приняло решение полностью отключить AI-детекцию Turnitin.

Исследование 2025 года (Chicago Booth Review) заключило: AI-детекторы непригодны как самостоятельный инструмент для принятия решений. Их результаты — это вероятностный сигнал, а не доказательство. Они никогда не должны использоваться для суждений о намерениях, усилиях или честности автора.

2.2. Дискриминация неносителей языка

Исследователи Стэнфордского университета обнаружили, что AI-детекторы показывали «почти идеальные» результаты при анализе эссе носителей американского английского, но ошибочно классифицировали 61,2% эссе на экзамене TOEFL (написанных неносителями языка) как сгенерированные ИИ. Более того, 97% этих эссе были помечены хотя бы одним из протестированных детекторов.

Таким образом, AI-детекторы не просто ненадежны — они системно дискриминируют определенные группы авторов. Отчет Common Sense Media указывает, что темнокожие студенты чаще подвергаются ложным обвинениям в AI-плагиате. Нейроотличные авторы, чей стиль письма не соответствует стандартным академическим нормам, также находятся в зоне риска — задокументирован случай студентки Центрального методистского университета с расстройством аутистического спектра, ложно обвиненной в использовании ИИ.

2.3. Легкость обхода

Ирония состоит в том, что при высокой частоте ложных срабатываний для людей, AI-детекторы легко обходятся при намеренном обмане. Тестирование Times Higher Education показало: достаточно попросить ChatGPT «писать как подросток», чтобы снизить уровень детекции Turnitin со 100% до 0%. Перефразирование текста снижает точность большинства детекторов на 20% и более.

Получается парадоксальная ситуация: инструменты наказывают честных авторов с нестандартным стилем письма, но бессильны против тех, кто намеренно маскирует ИИ-генерацию.

3. Скрейпинг авторского контента: «ИИ украл мои слова»

Центральный тезис Георгиу — модели обучаются на лучших человеческих работах, скрейпнутых из интернета без согласия авторов, а затем «присваивают» этот стиль. Масштаб проблемы в 2025 году стал очевиден.

3.1. Масштаб несанкционированного скрейпинга

Расследования выявили, что компании Meta, Microsoft и Nvidia извлекли более 15,8 миллиона видео с YouTube без согласия создателей контента, используя их для обучения генеративных моделей. Были идентифицированы как минимум 13 датасетов, используемых такими компаниями, как Amazon, ByteDance, Snap, Tencent, Apple и Anthropic.

Особенно показательна история, описанная в Bay State Banner: автор проверила главы своей книги через AI-детектор и получила высокий процент «AI-контента». Книга была написана в 2020 году, задолго до появления ChatGPT, полностью вручную. Позже выяснилось, что текст книги был скрейпнут и использован для обучения языковых моделей без ее ведома и согласия. Фактически, ИИ обучился на ее словах, а затем инструмент детекции обвинил автора в плагиате у ИИ — классический парадокс, описанный Георгиу.

3.2. Юридическая реакция

В мае 2025 года Бюро авторского права США выпустило 108-страничный отчет, заключив, что использование защищенных авторским правом произведений для обучения ИИ-моделей может являться нарушением права на воспроизведение. Ключевые судебные процессы 2025 года включают:

- Thomson Reuters v. Ross Intelligence — суд признал недопустимым использование материалов Thomson Reuters для обучения ИИ.

- NYT v. OpenAI — суд отказал OpenAI в прекращении дела, позволив рассмотреть обвинения в нарушении авторских прав при обучении моделей.

- Authors Guild v. OpenAI — коллективный иск авторов за включение их книг в обучающие данные GPT без согласия и компенсации.

- Disney & Universal v. Midjourney — обвинения в использовании интеллектуальной собственности для обучения генеративных моделей.

Судья Уильям Олсап в деле Bartz v. Anthropic описал использование авторских материалов для обучения LLM как «трансформативное — в высшей степени». Однако это определение не снимает вопрос о правах создателей оригинального контента.

4. Model Collapse: цена «каннибализма» данных

Георгиу предупреждает о феномене Model Collapse — деградации качества моделей при обучении на синтетических данных. Фундаментальное исследование этого явления было опубликовано в Nature группой Шумайлова и др.

4.1. Механизм деградации

При обучении новой модели на данных, произведенных предыдущим поколением ИИ, она наследует искажения, ошибки и смещения этих выходных данных. С каждым поколением распределение обучающих данных все дальше отклоняется от реальности. Модели начинают терять информацию о хвостах распределения — редких, но важных случаях. Результат — конвергенция к точечной оценке с минимальной дисперсией, или, проще говоря, усреднение и обеднение.

В наглядном эксперименте исследователи обучали OPT-125M (модель Meta) на данных каждого предыдущего поколения. После начального ввода об архитектуре одно из поколений модели стало генерировать тексты о кроликах с разноцветными хвостами — полный коллапс смысла.

4.2. Масштаб загрязнения интернета

К апрелю 2025 года более 74% новых веб-страниц содержали ИИ-генерированный текст. Это означает, что любая модель, обучающаяся на свежих данных из интернета, неизбежно впитывает все больше синтетического контента. Замкнутый круг: модели генерируют контент → контент попадает в интернет → следующее поколение моделей обучается на этом контенте → качество падает.

Проблема не выглядит как явная бессмыслица — в медицинских приложениях коллапс проявляется как вежливые, быстрые, но неправильные ответы: типовые рекомендации, которые скрывают редкие, но опасные симптомы.

4.3. Пути решения

Исследователи предлагают несколько подходов к митигации:

- Отслеживание провенанса данных — маркировка каждой единицы данных метаинформацией о ее источнике (реальный vs синтетический).

- Водяные знаки (watermarking) — внедрение незаметных для человека маркеров в выходные данные LLM.

- Верификация синтетических данных — использование модели-«дискриминатора» для фильтрации низкокачественных синтетических образцов.

- Сохранение доступа к человеческим данным — для задач, где хвосты распределения имеют значение, необходим доступ к оригинальным данным, созданным людьми.

Однако, как отмечают аналитики, окно для превентивных мер сужается — синтетический контент уже заполнил интернет.

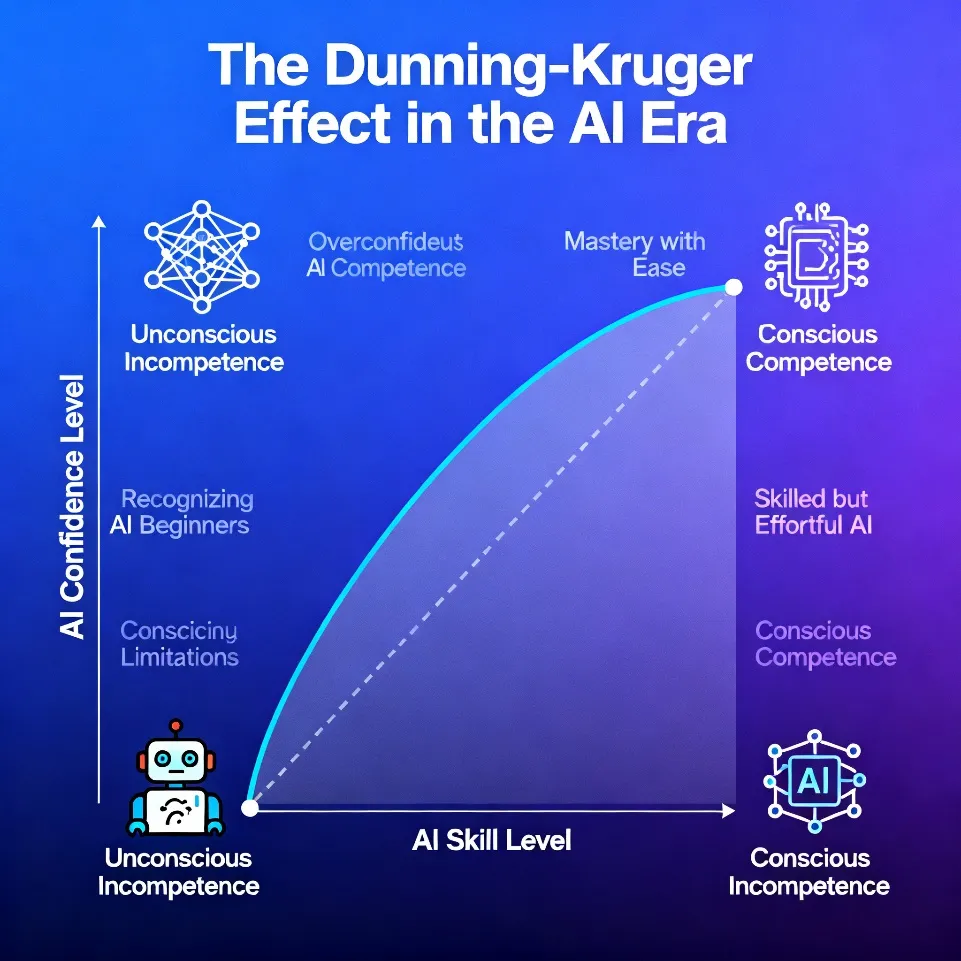

5. Эффект Данинга-Крюгера в эпоху ИИ

Георгиу поднимает еще одну критически важную тему: чрезмерное доверие к инструментам ИИ создает ложное ощущение компетентности. Исследование Университета Аалто (Финляндия), опубликованное в Computers in Human Behavior, подтвердило это экспериментально.

5.1. Классический эффект исчезает — и переворачивается

В традиционном эффекте Данинга-Крюгера некомпетентные люди переоценивают свои способности, а эксперты — недооценивают. При использовании ИИ этот паттерн разрушается: все пользователи без исключения — и новички, и опытные — переоценивают качество своей работы с ChatGPT.

Более того, исследователи обнаружили «обратный» эффект: пользователи с высокой ИИ-грамотностью демонстрируют еще большую переоценку своих результатов. Профессор Робин Велш отметил: «Когда дело касается ИИ, эффект Данинга-Крюгера исчезает» — но на его месте возникает нечто худшее.

5.2. Когнитивная разгрузка и метакогнитивный разрыв

Механизм этого явления связан с «когнитивной разгрузкой» (cognitive offloading): пользователи делегируют мышление системе и перестают критически оценивать результат. Минимальное взаимодействие — один промпт, один ответ — не оставляет пространства для метакогнитивной рефлексии и адекватной самооценки.

Растущий объем исследований указывает на риски: слепое доверие к ИИ ведет к «отуплению» способности критически оценивать информацию и деквалификации рабочей силы. Это напрямую перекликается с предупреждением Георгиу: пользователи верят в вердикт AI-детектора так же некритично, как верят в ответы ChatGPT — и в обоих случаях могут ошибаться.

6. Парадокс: обучение на лучшем — обвинение лучших

Центральный парадокс, выявленный Георгиу, заслуживает отдельного внимания. Цепочка событий выглядит так:

- Компании скрейпят интернет и собирают лучшие человеческие тексты для обучения LLM.

- LLM обучаются имитировать стиль, структуру и паттерны этих текстов.

- AI-детекторы обучаются отличать «человеческое» от «машинного» письма.

- Поскольку LLM научились писать «как лучшие авторы», детекторы начинают путать качественное человеческое письмо с ИИ-генерацией.

- Авторы, чьи работы были использованы для обучения, получают обвинения в плагиате у ИИ, который обучился на их же словах.

Этот парадокс имеет глубокие последствия для академической среды, журналистики и творческих профессий. Чем лучше и чище пишет автор, тем выше вероятность ложного срабатывания детектора — потому что именно такому стилю модель обучалась.

7. Что делать: рекомендации

На основе проведенного анализа можно сформулировать следующие рекомендации:

Для образовательных учреждений: AI-детекторы не должны быть единственным или решающим инструментом при оценке академической честности. Рекомендованный подход на 2026 год: детектор → экспертная проверка → анализ провенанса (история редактирования, авторский стиль, черновики).

Для законодателей: необходимы четкие правовые рамки для скрейпинга авторского контента. Модель opt-in (явное согласие автора) предпочтительнее модели opt-out (молчаливое согласие по умолчанию), поскольку последняя перекладывает бремя защиты на создателей контента.

Для разработчиков ИИ: прозрачность обучающих данных, внедрение водяных знаков, сохранение и приоритизация оригинальных человеческих данных при обучении новых поколений моделей.

Для пользователей: критическое отношение к результатам любых ИИ-инструментов — как генеративных, так и аналитических. Осознание эффекта когнитивной разгрузки и намеренное сохранение навыков независимой оценки.

8. Заключение

Эксперимент Георгиу — микрокосм более масштабного кризиса. Генеративный ИИ, обученный на человеческом творчестве, создает петлю обратной связи, в которой оригинальность авторов ставится под сомнение их же «учеником». AI-детекторы, призванные решить проблему, сами становятся ее частью — ненадежные, предвзятые, легко обходимые.

Model Collapse показывает, что без доступа к оригинальным человеческим данным модели деградируют. Эффект Данинга-Крюгера в контексте ИИ означает, что пользователи все меньше способны заметить эту деградацию. А юридическая система только начинает осмысливать масштаб нарушений авторских прав.

Простая модель «человек vs ИИ» в 2026 году уже не работает. Большинство текстов — это смесь человеческого замысла, ИИ-черновиков, человеческих правок и ИИ-полировки. Будущее требует не бинарных детекторов, а систем провенанса, прозрачности и — прежде всего — уважения к человеческому авторству.